不完全和简单注释的多点触摸及相关技术的编年录

最开始... 打字和N键响应(N-Key Rollover)(IBM及其它)

- 尽管看上去和多点触摸屏相差很远,但多点触摸的故事始于键盘。

- 尽管它们是机械式设备,比软件更“硬“,但是它们的确包含了多点触摸的技术。

- 起初,我们使用顺序组合键,诸如SHIFT,Control,Fn或ALT与其它键进行组合,这是多点触摸的雏形。

- 接着,我们想将不是故意但有时却不可避免地同时按下几个键的情况赋予正确含义,这就是所谓的N键响应(当你按住的前一个键未松开时按下另一个键)

电声音乐: 早期的电子触摸传感器(Hugh LeCaine , Don Buchla & Bob Moog).

http://www.hughlecaine.com/en/instruments.html

- 比PC更早的触控设备

- 许多早期的音效合成器和电子乐器的制作者们用接触式电容传感器来控制声音和音乐

- 这些是触摸板,不是触摸屏。

- 这些为音乐而设计的触控设备是多伦多大学的多点触摸表面和CMU Sensor Frame的早期基础。

1972: PLATO IV触摸屏终端((Computer-based Education Research Laboratory, University of Illinois, Urbana-Champain) http://en.wikipedia.org/wiki/Plato_computer

- 触摸屏在60年代后期开始研发。

- 早期工作成就于IBM, the University of Illinois, and Ottawa Canada.

- 到1971年许多不同的技术被揭开。

- 它们都是单点触摸,并且不能感应压力。

- 最早的普遍被大众所知的是PLATO IV电脑辅助教育系统的终端,开发于1972年

- 和使用触摸方式一样受人瞩目的是它的实时随机存储音频回放功能以及平板等离子显示。

- 它所用的触控技术是如今红外触控技术的前身,这项技术至今仍在使用(如CarrollTouch)

- 最初的设计具有16X16的触摸分辨率。

1981年: 用于机器人的触觉阵列传感器(Jack Rebman, Lord Corporation).

- 为一个可以感应形状、方向的机器人所设计的多点触摸传感器。

- 在一个4'X4'的正方形平板上由8X8阵列的传感器组成。

- 用法描述于Wolfeld, Jeffrey A. (1981). Real Time Control of a Robot Tactile Sensor. MSc Thesis. Philadelphia: Moore School of Electrical Engineering.

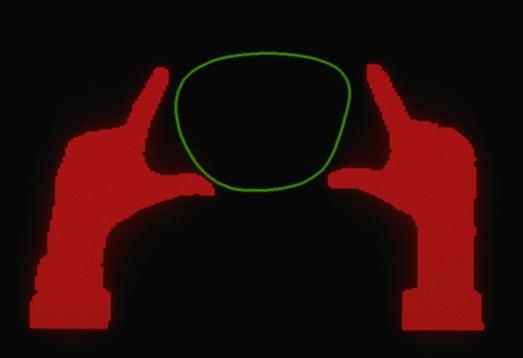

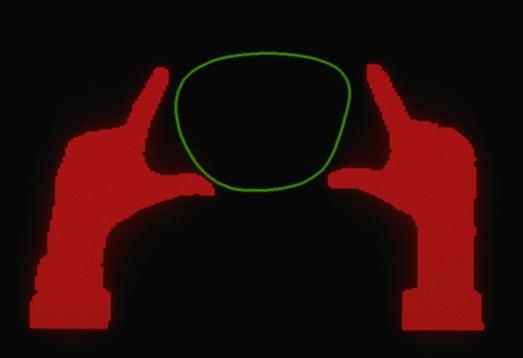

- 图片显示的是在一个触觉传感器上放置一个圆形物体的成像结果。Groover, M.P., Weiss, M., Nagel, R.N. & Odrey, N. (1986). Industrial Robots. New York: McGraw-Hill, p.152.)

- 1985年由Rebman申请了相关美国专利 (4,521,685)

1982: 柔性机界面 (Nimish Mehta , University of Toronto).

- 我所知道的第一个为电脑系统设计的多点触摸人机交互系统。

- 由一个毛玻璃面板构成,这种面板具有的光学特性可以让置于其后的摄像头记录下与手指在白色背景上的压力大小相关的黑点。这种特性和简单的图像处理结合就可以实现基于多点触摸的画图功能。那时候我们还讨论了用一个投影仪为摄像头和观众定义背景的想法

- Mehta, Nimish (1982), A Flexible Machine Interface, M.A.Sc. Thesis, Department of Electrical Engineering, University of Toronto supervised by Professor K.C. Smith.

1983:“软机器”(Soft Machines) (Bell Labs, Murray Hill)

- 我所知道的第一篇试图深入探讨基于触摸屏的用户界面特性的论文,他们称之为“软机器”。

- 尽管不是专门针对多点触摸技术,这篇论文勾画的许多特性使这种系统在某些应用背景中非常吸引人。

- Nakatani, L. H. & Rohrlich, John A. (1983). Soft Machines: A Philosophy of User-Computer Interface Design. Proceedings of the ACM Conference on Human Factors in Computing Systems (CHI’83), 12-15

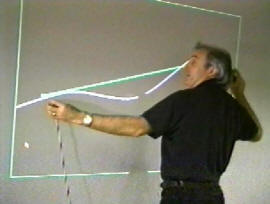

1983: 视频场所/视频书桌(Myron Krueger)

- 一个可视系统,可以跟踪手以及允许多个手指,手和人通过很多丰富的手势来进行交互操作。

- 可以用在很多地方,包括书桌和墙壁。

- 本身并不能感应触摸,因此主要根据姿势停留的时间来触发事件。

但是从用户的角度看来,在水平桌面的设置中,该系统是基于触摸感应的。

- 主要描写了大量的无阻碍的交互手势(不用手套,鼠标,触笔等)。

- 所做的工作非常超前且具有巨大影响力,但是认知度并不太高。

- 他所描述的大部分现在刚开始使用的手势可以从下面这个1988年的视频中看到,包括通过“pinching”的手势来缩放物体http://youtube.com/watch?v=dmmxVA5xhuo

- 还有很多这个系统的演示视频,任何在这个领域的人都应该看看,并且读一读以下这些书:

Krueger, Myron, W. (1983). Artificial Reality. Reading, MA:Addison-Wesley.

Krueger, Myron, W. (1991). Artificial Reality II. Reading, MA: Addison-Wesley.

Krueger, Myron, W., Gionfriddo, Thomas., &Hinrichsen, Katrin (1985). VIDEOPLACE - An Artificial Reality, Proceedings of the ACM Conference on Human Factors in Computing Systems (CHI’85), 35 - 40.

1984: 多点触摸屏(Bob Boie, Bell Labs, Murray Hill NJ)

- 一个多点触摸屏,不是平板。

- 第一个我所知道的多点触摸屏。

- 用一个透明的电容传感器阵列覆盖在CRT上。可以用很快的的相应速度通过手指操控图形物体。

- 由Bob Boie研发,但是由Lloyd Nakatani 向我展示的,他在1985年的SIGCHI上看到我们所做的工作后邀请我参观了贝尔实验室。

- 因为Boie的触摸屏是透明的,而且速度比我们的快,当我参观的时候,我认为他们已经领先于我们,所以我们就停止了在硬件上的研发(寄希望于可以获得他们的技术)并且专注于我们的强项:软件和交互方面。我们猜想Boie的技术会在不远的未来为我们所用(后来并没有)。

- 大概在1990年,我从Xerox带来一个小组来参观这个技术,因为我感觉它会很适合做我们大型文档处理器的用户界面,但是并没有成功。

- 在Boie时期的贝尔工作室中还有很多相关的多点触摸的工作,可以参阅1984年Leonard Kasday的工作( US Patent 4484179),他使用的是光学技术。

1985:多点触摸平板(Input Research Group, University of Toronto): http://www.billbuxton.com/papers.html#anchor1439918

1985:传感器框(Carnegie Mellon University)

- 是由Paul McAvinney所做的工作,并描述于1986年的这篇论文中:

McAvinney, P. (1986). The Sensor Frame - A Gesture-Based Device for the Manipulation of Graphic Objects. Carnegie-Mellon University,

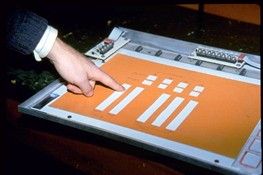

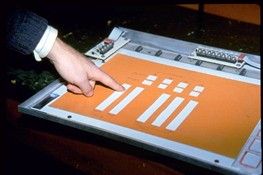

- 该设备使用安装在框角的光学传感器感应手指。

- 当时还没有微型摄像头,因此该设备使用DRAM IC和透明玻璃罩来进行成像。

- 可以在一定时间内相当可靠地感应最多三个手指(但是由于光学成像的原因,可能因为阴影造成误读)

- 在之后一款由NASA资助的设备原型the Sensor Cube中,设备可以检测到手指与屏幕所成的角度(见 http://ntrs.nasa.gov/archive/nasa/casi.ntrs.nasa.gov/19940003261_1994003261.pdf)

1986年:双手动输入(University of Toronto)

- 研究始于1985年,发表于次年,研究了使用两只手分别进行连续控制来完成两组不同的双输入任务的好处。

- 第一种是定位/调整任务。即一只手将某个图形移至屏幕上的某处,同时另一只手调整它的尺寸使之达到需要的目标。

- 第二种是选择/导航任务。即一只手在文档中搜索目前未被显示在屏幕上的某处,然后用另一只手选中它。

- 因为当时双手动输入的连续控制还很难实现(ADB还未被推出),我们用另一个电脑PERQ来模拟苹果电脑。

- 结果显示,这种连续的双手动控制对用户来说都很易于实现,而且在性能和学习能力上都有很大的改进。

- 参见 Buxton, W. & Myers, B. (1986). A study in two-handed input. Proceedings of CHI '86, 321-326.[video]

- 尽管这种能力自1986年开始被实现并商用化(使用ADB,见下和后来的USB),但仍没有主流系统采用这种基本的能力。太糟糕了。

- 这个例子说明基于多设备和多手操作的设计可以很简单地被转移到多点触控设备上。

1986:苹果桌面总线(ADB)和轨迹球滚动预置 (Apple Computer / University of Toronto)

- 苹果桌面总线连同苹果II代和苹果SE一同发布,这可以被视为USB的早期版本。

- 它支持即插即用,并且支持多种输入设备(键盘,轨迹球,游戏棒,鼠标等等)同时接入一台电脑。

- 唯一的缺憾是如果你同时接入两个定位设备,缺省状态下,软件并不能区分它们。它们都进行相同的工作,如果一个鼠标和轨迹球同时运行,那么你会看到它们在屏幕上争夺运行轨迹。

- 我在多伦多大学的小组想要利用这个多设备的优势并向苹果高级技术小组发出求助。

- 在Gina Venolia and Michael Chen的努力下,他们做出了一个用于系统文件夹的轨迹球滚动预置。

- 它能使鼠标和轨迹球分别操控滚动条的X和Y方向的滑动,见 Buxton, W. (1990). The Natural Language of Interaction: A Perspective on Non-Verbal Dialogues.In Laurel, B. (Ed.). The Art of Human-Computer Interface Design, Reading, MA: Addison-Wesley. 405-416.

- 它还可以提供另一项预置功能,使我们可以从第二个设备获取信号并利用它控制其他功能。比如 Kabbash, P., Buxton, W.& Sellen, A. (1994). Two-Handed Input in a Compound Task. Proceedings of CHI '94, 417-423.

- 简而言之,使用这个技术,我们可以将 Buxton & Myers(见上)所演示的优点用于标准硬件,无需更改操作系统,并且通常无需改动相应的应用。

这是我们距离支持多点触摸输入最接近的一次,虽然实际上并没有成功地实现。20年后的今天,那些诸如两点缩放的技术获得了这么大的关注。但实际上在那个时候就已经可以在技术上和商业上应用了。

- 令我们失望的是,苹果当时并没有利用这一他们最感兴趣的发明的优势。

1991 双向显示(Bill Buxton & Colleagues , Xerox PARC)

- 第一次关于将LCD显示做为输入设备可行性的讨论,比如把像素既作为输入也作为输出设备。(想像我们小时候用纸杯和线做的电话:纸杯是双向的,同时用做话筒和麦克风)

- 采用用于扫描仪的高精度2D a_Si 扫描技术并增加显示层用于显示。在研发的过程中,双向的目标没有实现,但是却催生了dpix display (http://www.dpix.com/about.html);

- 电子板项目。背后投影电子板起初是构想为一个采用双向dpix显示阵列的平板器件原型。

1991:电子书桌 (Pierre Wellner, Rank Xerox EuroPARC, Cambridge)

- 一篇关于实物放大的经典论文:

- Wellner, P. (1991). The Digital Desk Calculator: Tactile manipulation on a desktop display. Proceedings of the Fourth Annual Symposium on User Interface Software and Technology (UIST '91), 27-33.

- 早期的前置投影桌面系统,采用光学和声学技术检测手/手指和其他物体,特别是基于纸张的控制和数据。

- 清楚的演示了多点触控的概念,比如用两个手指缩放和转换图形物体,使用pinch手势等。

- 比如,这个1991年的视频演示(从6分30秒) http://video.google.com/videoplay?docid=5772530828816089246

1992:翻转键盘 (Bill Buxton, Xerox PARC): www.billbuxton.com

1992: Simon (IBM & Bell South)

- IBM和Bell South推出了有争议的世界上首个智能手机 Simon

- 有趣的是,Simon和iPhone一样采用触摸屏驱动的“软机器”的用户界面。

- 虽然只是单点触摸,Simon预示了很多我们现在使用的基于触摸屏的手机设备特性。

- 花絮:我的Simon是我众多输入设备收藏中最珍贵的一个。

1992: Wacom (Japan)

- 1992年Wacom推出了电子桌面的UD系列产品,它们具有多设备,多点感应能力。它们可以感应触笔的位置和笔尖压力,也可同时像鼠标定位器一样感应位置,这是通过双手动输入来实现的。

- 我的多伦多大学实验室与Wacom合作开发了很多基于此技术并超前于触笔和鼠标定位的操作方式。详见下面的 Graspable/Tangible interfaces

- 它们的后续两代电子桌面产品 Intuos 1(1998)和Intuos 2 (2001) 扩充了多点触摸的能力。它们能够感应触笔位置的X,Y坐标,在X,Y方向上的倾斜角度(使得触笔的功效相当于一个可感应位置的游戏棒),接触压力和装在喷枪触笔边上的表盘读数。同时,它可以同时感应定位器的位置和旋转角度,以及装在它侧面的一个转盘的旋转。总共一个人可以通过两只手控制10种不同的维度。

- 尽管这看上去很夸张并且很难被控制,但是这取决于如何使用它。比如,所有这些信号和双手动输入一起可以名副其实地实现数字喷枪。有了这些技术,我的Alias|Wavefront小组和Wacom合作就可以实现它。

- 另见Leganchuk, A., Zhai, S.& Buxton, W. (1998).Manual and Cognitive Benefits of Two-Handed Input: An Experimental Study.Transactions on Human-Computer Interaction, 5(4), 326-359.

1992:Starfire (Bruce Tognazinni , SUN Microsystems)

- Bruce Tognazinni拍摄了一步未来的展望影片,Starfire,包括了很多多手,多手指交互操作,包括pinch等

1994-2002: 双手动研究(Alias|Wavefront Toronto)

1995:实控界面(Graspable/Tangible)(Input Research Group, University of Toronto)

- 在一个数字桌面显示上所感应的各种物理设备的身份、位置甚至旋转角度,并通过它们控制图形物体。

- 通过相关的论文介绍了被称为“实控”的计算。

- Fitzmaurice, G.W., Ishii, H. & Buxton, W. (1995). Bricks: Laying the foundations for graspable user interfaces. Proceedings of the ACMSIGCHI Conference on Human Factors in Computing Systems (CHI'95), 442–449.

1995 DSI Datotech (Vancouver BC)

- 1995年,这家公司推出了一种触摸板,HandGear,可以感应多点触摸。他们也开发了一套软件包Gesture Recognition Technology (GRT), 用来识别触摸板捕捉到的手势。

- 公司大约在2002年破产。

1995/97: Active Desk (Input Research Group / Ontario Telepresence Project, University of Toronto)

- 大概在1992年,我们做了一个具有背面投影显示的绘图桌,背投屏幕/桌面是一个由半透明触笔操控的数字图形桌面(Scriptel)。触笔由常用手进行操作。1995年,我们在桌面上安装了一个摄像头。它可以跟踪非常用手在桌面的位置,以及拇指和食指所成的姿势(张开的角度)。非常用手可以通过在虚拟物体上张开或并拢拇指食指的方式抓住并操纵物体。这个显示工作是由一个学生Yuyan Liu所做。

- Buxton, W. (1997). Living in Augmented Reality: Ubiquitous Media and Reactive Environments. In K. Finn, A. Sellen & S. Wilber (Eds.). Video Mediated Communication. Hillsdale, N.J.: Erlbaum, 363-384. An earlier version of this chapter also appears in Proceedings of Imagina '95, 215-229.

1997: T3 (Alias|Wavefront, Toronto)

- T3是一个基于双手动输入的平板系统,它所使用的技术可以或已经同样很好地被应用在多点触摸设备中。

- 这些技术包括且不仅限于通过手的开合动作来抓住一个图画界面并通过其两端调整大小。类似的也可以对背景中的单独图形物体进行同样操作(这仅是将Ivan Sutherland’s Sketchpad系统中的概念用多点操控来进行实现)。

- 类似的,还可以抓中一个物体通过其两点旋转,同时控制轴心和旋转角度。同样还可以移动物体。

- 有趣的是可以将诸如移动,缩放的操作同时进行。

- Kurtenbach, G., Fitzmaurice, G., Baudel, T. & Buxton, W. (1997). The design and evaluation of a GUI paradigm based on tabets, two-hands, and transparency. Proceedings of the 1997 ACM Conference on Human Factors in Computing Systems, CHI '97, 35-42. [video].

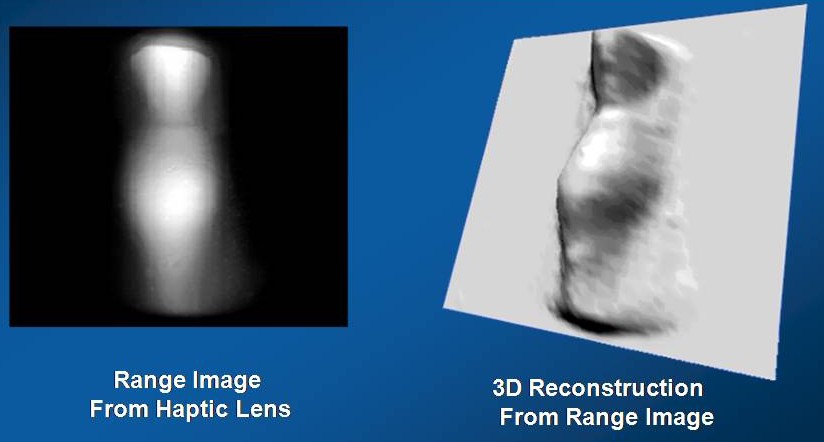

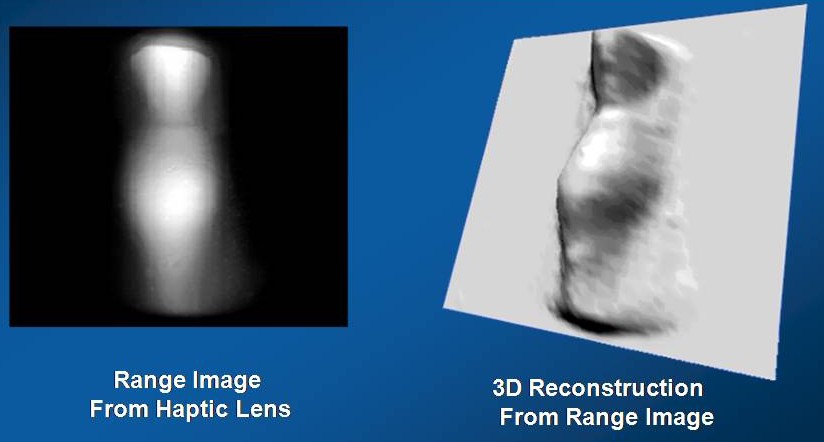

1997 The Haptic Lens (Mike Sinclair, Georgia Tech / Microsoft Research)

- 触感镜片,一个具有粘土触感的多点触摸传感器,当你用力挤压它的时候,它会发生形变,而松开它的时候又会恢复原状,是一种新奇的设备。

- Sinclair, Mike (1997). The Haptic Lens. ACM SIGGRAPH 97 Visual Proceedings: The art and interdisciplinary programs of SIGGRAPH '97, Page: 179

1998 Tactex Controls (Victoria BC) http://www.tactex.com/

1998: Fingerworks(Newark, Delaware)

- 开发了一系列具有多点触摸功能的触控板,包括 iGesture Pad。它们支持很丰富的多点/多手指手势库。

- 该公司由Delaware大学的John Elias and Wayne Westerman联合成立。

- 产品主要基于Westerman的论文 Westerman, Wayne (1999). Hand Tracking,Finger Identification, and Chordic Manipulation on a Multi-Touch Surface. U of Delaware PhD Dissertation: http://www.ee.udel.edu/~westerma/main.pdf

- 注意Westerman所作的工作也是建立在以上介绍的前人工作基础之上的。他的论文引用了Matha 1982年多点触摸的工作,Krueger介绍pinch手势的工作。所引用的172个出处,34(20%)个是我和/或我学生的工作。

- 公司在2005年被苹果电脑收购。

- Elias和Westerman进入苹果公司。

- Fingerworks停止作为一个独立公司运营。

- 但是它仍然有很多忠实用户和许多文档,包括教程和使用手册仍然可以下载http://www.fingerworks.com/downloads.html

1999: Portfolio Wall (Alias|Wavefront, Toronto On, Canada).

- 一种数字白板,上面的图像可以成组或单独显示,允许图像被分类,标注,和排序显示。

- 由于传感器技术的限制,没有使用多点触摸。但是它的基于手指触摸手势的界面效果要超过当时使用的典型触摸屏界面和一些移动设备的触控界面。

- 比如,看下一幅图可以用手指向右轻拂实现,而看前一幅图向左轻拂即可。

- 手势不仅只支持左右滑动,用户还可以根据手指移动的方向触发不同的事件。

- 在这个系统中,一共有8个选项,对应指南针的8个主要方位。比如,在播放的视频中一个向下的手势意思是“停止”。向右上的手势开启注释功能,右下手势打开与图像有关的应用,等等。

- 见演示 http://www.billbuxton.com/buxtonAliasVideos.html

2001: Diamond Touch (Mitsubishi Research Labs, Cambridge MA) http://www.merl.com/

2002: Jun Rekimoto Sony Computer Science Laboratories (Tokyo) http://www.csl.sony.co.jp/person/rekimoto/smartskin/

2002: Andrew Fentem (UK)http://www.andrewfentem.com/

- 此人声称自2002年开始从事面向音乐和通用应用的多点触摸工作。

- 但是似乎从未在科技会议或论文中发表相关的工作。

- 因此在这个时期的工作很少人知道,而且因为没有研究结果的发表,没有得到其他人的引用。

- 所以他的工作对这个技术进化的影响很小。

- 我引用的这个例子说明还有很多类似的工作没有被报道出来,在这里只举这一个例子说明这种情况。

2003:多伦多大学(Toronto)

- 论文描述了在一个交互触摸显示界面上所应用的多手指,多手和多用户交互技术。

- 许多之前所用的简单技术因为其广为人知在这篇论文中被忽略

- Mike Wu, Mike & Balakrishnan, Ravin (2003). Multi-Finger and Whole Hand Gestural Interaction Techniques for Multi-User Tabletop Displays. CHI Letters

2003: Jazz Mutant(Bordeaux France) http://www.jazzmutant.com/

- 首个透明的多点触控,据我所示,是首个商用的多点触控应用

。

- 产品名称叫做Lemur,一个具有真正多点触控屏幕界面的音乐控制器。

- Lemur早期版本发布于2004年8月的LA

2004: TouchLight(Andy Wilson, Microsoft Research): http://research.microsoft.com/~awilson/

- TouchLight(2004) 一个触摸屏显示系统,采用背投显示和数字图像处理。将普通的丙烯酸塑料转换成一个高带宽输入输出表面,适于基于手势的交互方式。网站上有视频展示。

- 能够感应多手指多手和多用户。

- 因为丙烯酸材料是透明的,置于其后的摄像头可以实现扫描仪的功能来扫描置于其上的文档

2005 Blaskó and Steven Feiner (Columbia University): http://www1.cs.columbia.edu/~gblasko/

2005: PlayAnywhere (Andy Wilson, Microsoft Research): http://research.microsoft.com/~awilson/

- PlayAnywhere (2005). 网站上有视频演示。

- 贡献:感应、识别物体和触摸。

- 一个前置投射式电脑视觉交互桌面系统。

- 讨论了安装,校正和便携性这些视觉桌面系统的典型问题。

- 使用改进的基于阴影的触摸感应算法来感应手指,手和物体。

- 物体可以通过一个快速简单的视觉编码方案被快速识别和跟踪。因此,加上多点触摸,桌面支持使用各种物理物体的交互方式,也支持实控方式的界面。

- 它也可以感应特殊物体,比如一张纸或一个手机,并且根据对象传递所需的功能。

2005 Jeff Han(NYU): http://www.cs.nyu.edu/~jhan/

----> 2006: Perceptive Pixel http://www.perceptivepixel.com/

2005: Tactiva(Palo Alto) http://www.tactiva.com/

- 已经发布了一款名为TactaPad的产品,并展示了视频演示。

- 它利用光学原理捕捉手在电脑屏幕上的阴影和叠影,有一种如临其境的体验感觉,很像前面的Krueger的工作。

- 支持多手和多点触摸。

- 是具有触感的触摸板,或者说,平板表面根据你所触摸的不同虚拟物体或进行的不同操作会反馈给你不同的感觉。

2005: Toshiba Matsusita Display Technology (Tokyo)

2005: Tomer Moscovich & collaborators (Brown University)

2006: Benko & collaborators (Columbia University & Microsoft Research)

2006: Plastic Logic (Cambridge UK)

- 在多点触摸板上方安置的柔软的电子墨水显示屏,即一个可交互的多点触摸显示。

- 在2006 SID conference, San Francisco.的Trade Show中做了演示。

2006: Synaptics & Pilotfish (San Jose) http://www.synaptics.com

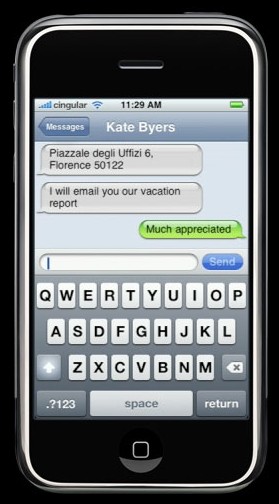

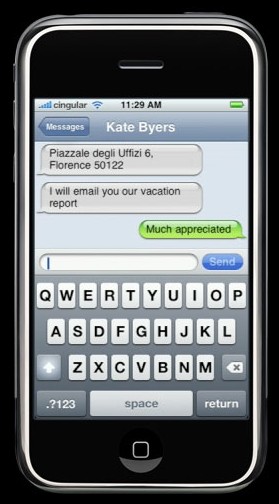

2007: Apple iPhone http://www.apple.com/iphone/technology/

- 与1992年的Simon一样,一个具有软触摸接口的手机。

- 杰出的工业设计和非常平顺的交互功能。

- 能够实现具有有限维度的多点触控。

- 利用它能够实现比如最先由Krueger介绍的"pinching"技术,即用一只手的大拇指和食指实现对地图和照片的缩放操作。

- 使用浏览器浏览网页的功能非常好用。

- 采用Alias Portfolio Wall 式的手势向前和向后滚动浏览一系列图片。

- 一开始不能用一个手指按住shift键而另一只手指键入其它字母来实现大写功能,直到发布的一年后才支持这个多点触摸功能。

2007: Microsoft Surface Computing http://www.surface.com

- 交互桌面。

- 能感应多个手指和手。

- 能识别多种物体和它们在表面上的位置。

- 广告展示和内部研发始于2001年,由Andy Wilson (see above) 和Steve Bathiche进行。

- 该技术从研发和demo转向主流商业应用的重要象征。

2007: ThinSight, Microsoft Research Cambridge (UK) http://www.billbuxton.com/UISTthinSight.pdf

- 可用于LCD显示的轻薄多点触摸技术。

- 因此可以用于笔记本。

- 采用光学技术,可以感应手指和物体。

- 可用于触摸和实控方式的交互。

2008: N-trig http://www.n-trig.com/

- 商用的多点触摸感应器。

- 可同时感应手指和触笔。

- 与大多数支持触笔的感应器不同,它集成了专门的触笔感应器。

- 因此可用触笔实现高品质的数字墨水。

- 应用于最新的一些平板PC产品。

- 适用于大尺寸的技术,比如桌面大小。

/3

/3

文章评论(0条评论)

登录后参与讨论