资料显示,初代华为盘古大模型发布于2021年,其是基于昇腾计算产业生态,产业链和昇腾生态产业链重合,主要分为应用软件伙伴、IHV硬件伙伴、整机硬件伙伴、一体机解决方案伙伴、辅助运营伙伴。

盘古大模型的技术原理

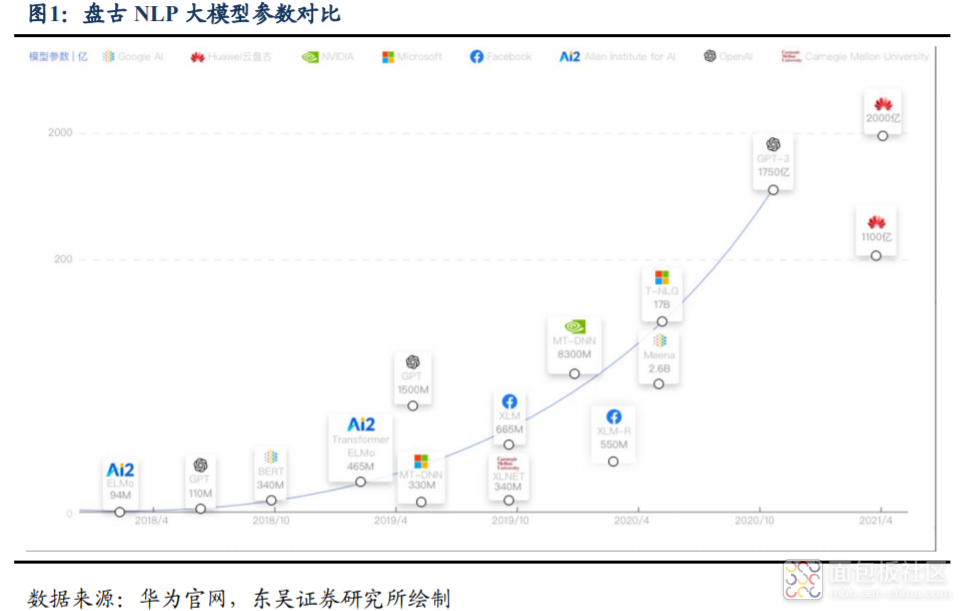

盘古大模型采用了深度学习和自然语言处理技术,并使用了大量的中文语料库进行训练。该模型拥有超过1千亿个参数,可以支持多种自然语言处理任务,包括文本生成、文本分类、问答系统等等。与GPT等外国AI模型相比,盘古大模型更注重针对中文语言的优化,使用了大量的中文语料库进行训练,可以更好地理解中文语言的语法和语义。此外,盘古大模型还融入了华为在5G、云计算、物联网等领域的技术优势,可以更好地应用于这些领域的实际场景。

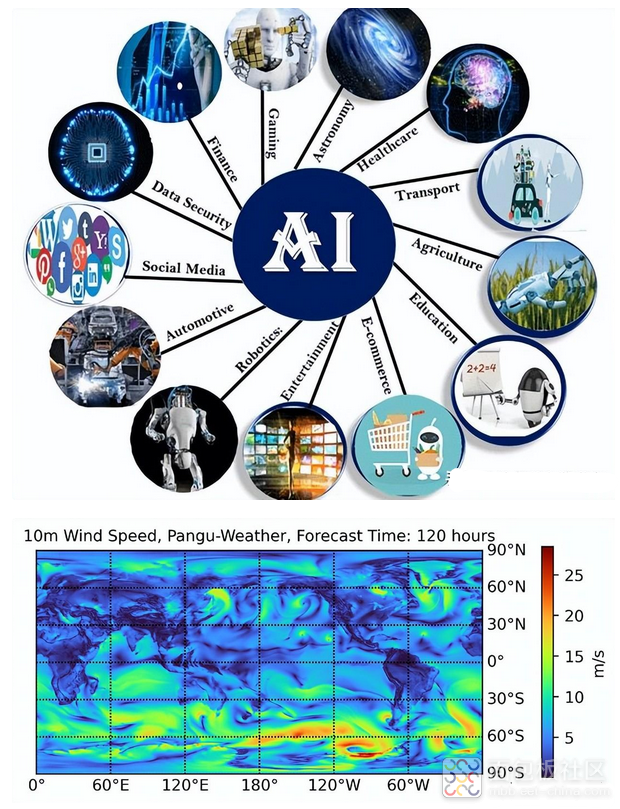

盘古大模型的应用领域

盘古大模型的应用场景包括智能客服、机器翻译、语音识别等领域。例如,在智能客服领域,盘古大模型可以通过自然语言处理技术实现自动回复、意图识别等功能,为客户提供更加智能化的服务。在机器翻译领域,盘古大模型可以将英文或其他语言翻译为中文,并进行语言流畅度和语法纠错等处理,提高翻译的准确度和质量。在语音识别领域,盘古大模型可以通过语音识别技术实现语音转文字,并进行语音分析和语义理解,为用户提供更加智能化的语音识别服务。此外,盘古大模型还可以应用于智能家居、自动驾驶等领域,为这些领域提供更加智能化的技术支持。

盘古气象大模型

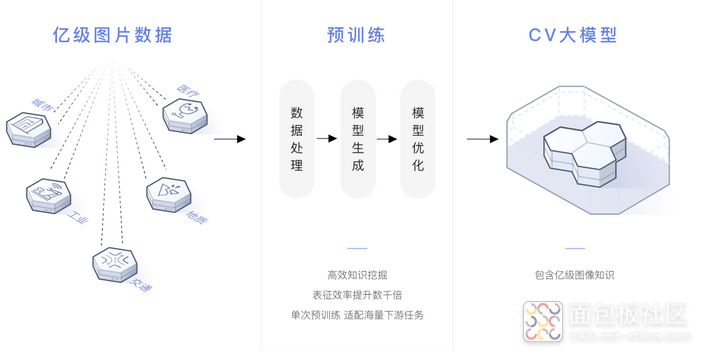

盘古CV大模型

华为盘古AI大模型拆解:

1、驱动因子:华为盘古大模型预期4月将发布,而当下了解的到的情况来看,远超百度文心一言。

为什么超过百度?华为的全球现存手机用户数仅3.8亿,华为2021年营收6368亿元净利大增76%至1137亿元,而百度21年营收才1245亿,净利102亿。所以从这个体量来看华为比百度大10倍不止。

2、华为盘古大模型的四层架构:昇腾/鲲鹏→MindSpore AI框架→ModelArts AI开发平台→盘古大模型。

- AI算力资源:“鲲鹏+昇腾”,打造盘古算力底座。鲲鹏生态以华为自主芯片→鲲鹏芯片→鲲鹏服务器→欧拉操作系统→高斯数据库→行业应用向外扩张,构建鲲鹏生态,提供算力支撑。鲲鹏生态以昇腾AI处理器→CANN异构计算架构→MindSpore AI框架→应用使能→行业应用,助力打造华为昇腾全栈AI软硬件平台,构筑智能世界基石。二者共同为盘古大模型提供底层算力核心支撑。

- 框架Mindspore:其中CANN作为华为昇腾AI基础软硬件平台的核心,向上支持多种AI框架,向下服务AI处理器与编程,Mindspore是国内首个支持千亿参数大模型训练AI计算框架,最佳匹配昇腾处理器算力,支持终端、边缘、云全场景灵活部署,开创全新的AI编程范式,降低AI开发门槛。

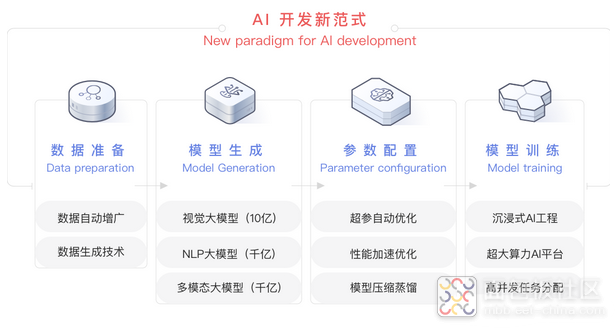

- AI开发平台,大模型ModelArts:一站式AI开发平台,沉淀了知识计算、盘古大模型和天筹AI求解器三项AI根技术。从算力资源调度、AI业务编排、AI资产管理以及AI应用部署,为机器学习与深度学习提供海量数据预处理及交互式智能标注、大规模分布式训练、自动化模型生成,及端-边-云模型按需部署能力,帮助用户快速创建和部署模型,管理全周期AI工作流。

- 盘古大模型:由NLP大模型、CV大模型、多模态大模型、科学计算大模型等多个大模型构成,目前已实现等AI场景落地。

3、中美AI大模型研究对比:通过以上维度比对,你们就知道中美当下的差距,从参数与数据堆量来看,百度才100亿,数据只有4TB,而GPT4达到了1750亿,数据45TB。而当下最有一拼的就是华为,有钱有人有实力去PK的,而从当下了解的他的参数以达到1000亿,数据40TB,而从这个数据来看以达到了GPT3.5的版本,而未来跟上节奏,起码不会跑输太远。而这一点才像我上面说的为什么华为百度强的不是一点。数据和体量能说明一切!

1、驱动因子:华为盘古大模型预期4月将发布,而当下了解的到的情况来看,远超百度文心一言。

为什么超过百度?华为的全球现存手机用户数仅3.8亿,华为2021年营收6368亿元净利大增76%至1137亿元,而百度21年营收才1245亿,净利102亿。所以从这个体量来看华为比百度大10倍不止。

2、华为盘古大模型的四层架构:昇腾/鲲鹏→MindSpore AI框架→ModelArts AI开发平台→盘古大模型。

- AI算力资源:“鲲鹏+昇腾”,打造盘古算力底座。鲲鹏生态以华为自主芯片→鲲鹏芯片→鲲鹏服务器→欧拉操作系统→高斯数据库→行业应用向外扩张,构建鲲鹏生态,提供算力支撑。鲲鹏生态以昇腾AI处理器→CANN异构计算架构→MindSpore AI框架→应用使能→行业应用,助力打造华为昇腾全栈AI软硬件平台,构筑智能世界基石。二者共同为盘古大模型提供底层算力核心支撑。

- 框架Mindspore:其中CANN作为华为昇腾AI基础软硬件平台的核心,向上支持多种AI框架,向下服务AI处理器与编程,Mindspore是国内首个支持千亿参数大模型训练AI计算框架,最佳匹配昇腾处理器算力,支持终端、边缘、云全场景灵活部署,开创全新的AI编程范式,降低AI开发门槛。

- AI开发平台,大模型ModelArts:一站式AI开发平台,沉淀了知识计算、盘古大模型和天筹AI求解器三项AI根技术。从算力资源调度、AI业务编排、AI资产管理以及AI应用部署,为机器学习与深度学习提供海量数据预处理及交互式智能标注、大规模分布式训练、自动化模型生成,及端-边-云模型按需部署能力,帮助用户快速创建和部署模型,管理全周期AI工作流。

- 盘古大模型:由NLP大模型、CV大模型、多模态大模型、科学计算大模型等多个大模型构成,目前已实现等AI场景落地。

3、中美AI大模型研究对比:通过以上维度比对,你们就知道中美当下的差距,从参数与数据堆量来看,百度才100亿,数据只有4TB,而GPT4达到了1750亿,数据45TB。而当下最有一拼的就是华为,有钱有人有实力去PK的,而从当下了解的他的参数以达到1000亿,数据40TB,而从这个数据来看以达到了GPT3.5的版本,而未来跟上节奏,起码不会跑输太远。而这一点才像我上面说的为什么华为百度强的不是一点。数据和体量能说明一切!

盘古NLP大模型

盘古大模型的优势

- 中文优化:盘古大模型使用了大量的中文语料库进行训练,可以更好地理解中文语言的语法和语义,从而提高模型的准确度和质量。

- 技术支持:盘古大模型融入了华为在5G、云计算、物联网等领域的技术优势,可以更好地应用于这些领域的实际场景,为华为提供强有力的技术支持。

- 应用广泛:盘古大模型可以应用于智能客服、机器翻译、语音识别等多个领域,为这些领域提供更加智能化的技术支持。

- 超大规模:盘古大模型拥有超过1千亿个参数,是目前世界上最大的中文AI模型之一,可以支持多种自然语言处理任务,包括文本生成、文本分类、问答系统等等。

- 可扩展性:盘古大模型采用了分布式计算技术,可以实现模型的在线训练和增量学习,可以随着数据量的增加不断优化模型,提高模型的准确度和质量。

- 训练成本高:由于盘古大模型拥有超大规模的参数,需要消耗大量的计算资源和存储资源进行训练,因此训练成本较高。

- 数据安全问题:由于盘古大模型需要使用大量的中文语料库进行训练,可能会涉及到用户隐私和数据安全问题,需要采取相应的措施进行保护。

- 语义理解问题:尽管盘古大模型在中文语言的处理方面具有很高的准确度和质量,但是在语义理解方面仍存在一定的局限性,尤其是在处理复杂的语言结构和语义推理方面。

- 竞争压力:目前,国内外许多企业都在研发超大规模的AI模型,盘古大模型在这个领域面临着激烈的竞争压力,需要不断优化和提高模型的性能和质量,以保持在市场中的领先地位。

/5

/5