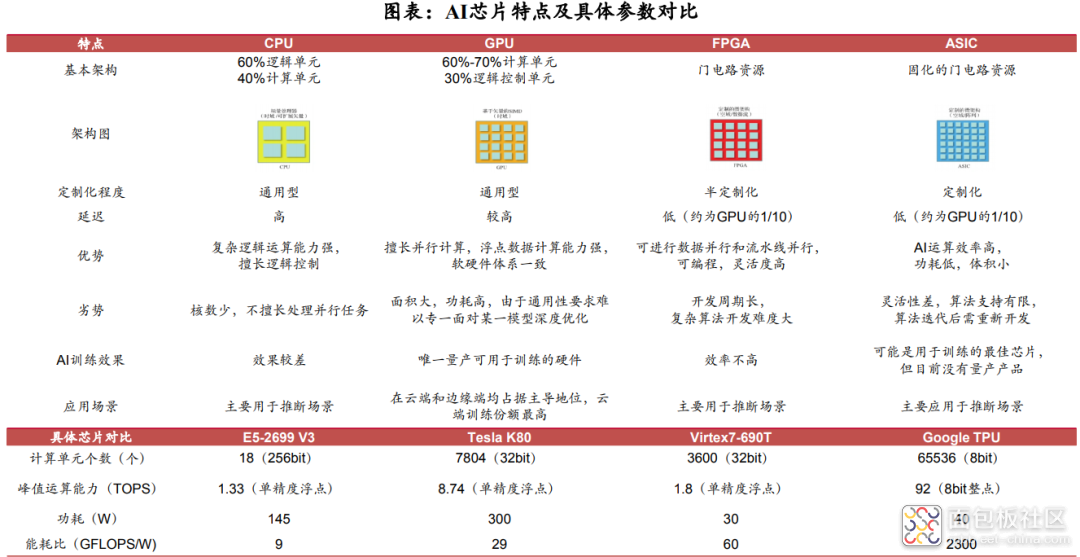

从技术架构来看,AI芯片主要分为图形处理器(GPU)、现场可编程门阵列(FPGA)、专用集成电路(ASIC)、中央处理器(CPU)四大类。其中,GPU是较为成熟的通用型人工智能芯片,FPGA和ASIC则是针对人工智能需求特征的半定制和全定制芯片,GPU、FPGA、ASIC作为加速芯片协助CPU进行大规模计算。

三类芯片用于深度学习时各有优缺点:1)通用性:GPU>FPGA>ASIC,通用性越低,代表其适合支持的算法类型越少。2)性能功耗比:GPU<FPGA<ASIC,性能功耗比越高越好,意味着相同功耗下运算次数越多,训练相同算法所需要的时间越短。

目前AI芯片主要被国际厂商垄断,根据Co unterpoint、IDC数据,Intel和AMD共计占2022年全球数据中心CPU市场收入的92.45%,Nvidia占2021年中国加速卡市场份额的80%以上。

1.CPU:底层核心算力芯片

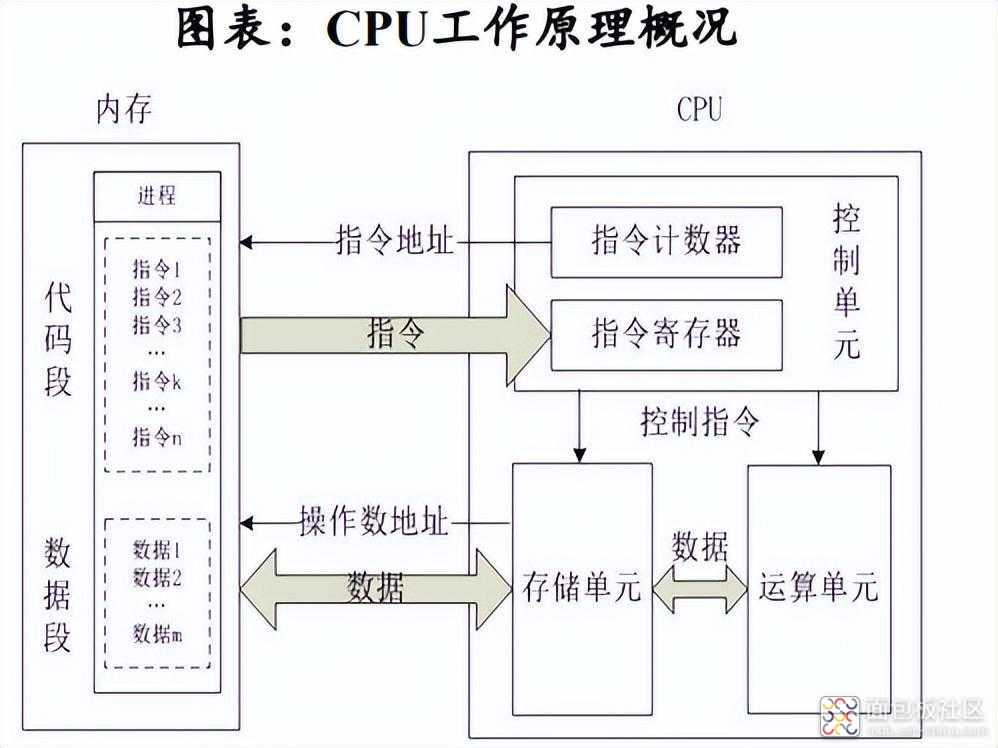

CPU(Central Processing Unit)中央处理器:是计算机的运算和控制核心(Control Unit),是信息处理、程序运行的最终执行单元,主要功能是完成计算机的数据运算以及系统控制功能。

CPU擅长逻辑控制,在深度学习中可用于推理/预测。在深度学习中,模型的训练和推理是两个不同的过程:在训练过程中,模型需要进行大量的矩阵运算,因此通常使用GPU等擅长并行计算的芯片进行处理;在推理过程中,需要对大量的已经训练好的模型进行实时的推理/预测操作,而这种操作通常需要高效的逻辑控制能力和低延迟的响应速度,这正是CPU所擅长的。

2.GPU:AI高性能计算王者

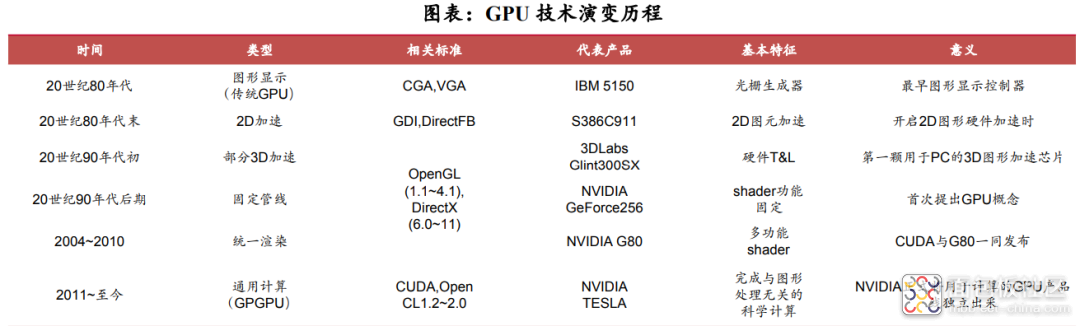

GPU(Graphics Processing Unit)图形处理器:GPU最初是为了满足计算机游戏等图形处理需求而被开发出来的,但凭借高并行计算和大规模数据处理能力,逐渐开始用于通用计算。根据应用场景和处理任务的不同,GPU形成两条分支:传统GPU:用于图形图像处理,因此内置了一系列专用运算模块,如视频编解码加速引擎、2D加速引擎、图像渲染等;GPGPU:通用计算图形处理器(general-purpose GPU)。为了更好地支持通用计算,GPGPU减弱了GPU图形显示部分的能力,将其余部分全部投入到通用计算中,同时增加了专用向量、张量、矩阵运算指令,提升了浮点运算的精度和性能,以实现人工智能、专业计算等加速应用。

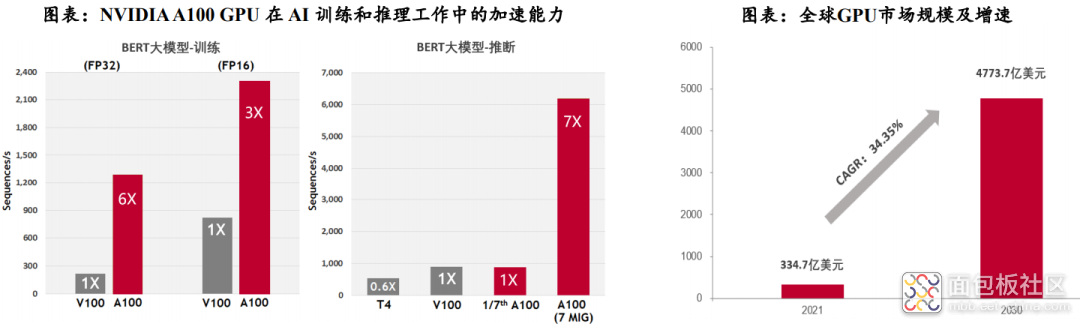

GPU在AI模型构建中具有较高的适配性。GPU的高并行性可以更好地支持AI模型训练和推理过程中大量的矩阵或向量计算,以NVIDIAGPU系列旗舰产品A100为例:根据NVIDIA公布的规格参数,A100的深度学习运算性能可达312Tflops。在AI训练过程中,2048个A100GPU可在一分钟内成规模地处理BERT的训练工作负载;在AI推理过程中,A100可将推理吞吐量提升到高达CPU的249倍。

AI模型与应用的加速发展推动GPU芯片放量增长。根据Verified Market Research数据,2021年全球GPU市场规模为334.7亿美元,预计2030年将达到4773.7亿美元,CAGR(2021-2030)为34.35%。从国内市场来看,2020年中国大陆的独立GPU市场规模为47.39亿元,预计2027年市场规模将达345.57亿美元,CAGR(2021-2027)为32.8%。

3.FPGA:可编程芯片加速替代

FPGA(Field Programmable Gate Array)现场可编程门阵列:FPGA最大的特点在于其现场可编程的特性,无论是CPU、GPU还是ASIC,在芯片制造完成后功能会被固定,用户无法对硬件功能做出更改,而FPGA在制造完成后仍可使用配套软件对芯片进行功能配置,将芯片上空白的模块转化为自身所需的具备特定功能的模块。

(1)可编程性、高并行性、低延迟、低功耗等特点,使得FPGA在AI推断领域潜力巨大

FPGA可以在运行时根据需要进行动态配置和优化功耗,同时拥有流水线并行和数据并行能力,既可以使用数据并行来处理大量数据,也能够凭借流水线并行来提高计算的吞吐量和降低延迟。根据与非网数据,FPGA(Stratix10)在计算密集型任务的吞吐量约为CPU的10倍,延迟与功耗均为GPU的1/10。

云端推断:在面对推断环节的小批量数据处理时,GPU的并行计算优势不明显,FPGA可以凭借流水线并行,达到高并行+低延迟的效果。根据IDC数据,2020年中国云端推理芯片占比已超过50%,预计2025年将达到60.8%,云端推断市场广阔。边缘推断:受延迟、隐私和带宽限制的驱动,FPGA逐渐被布署于IoT设备当中,以满足低功耗+灵活推理+快速响应的需求。

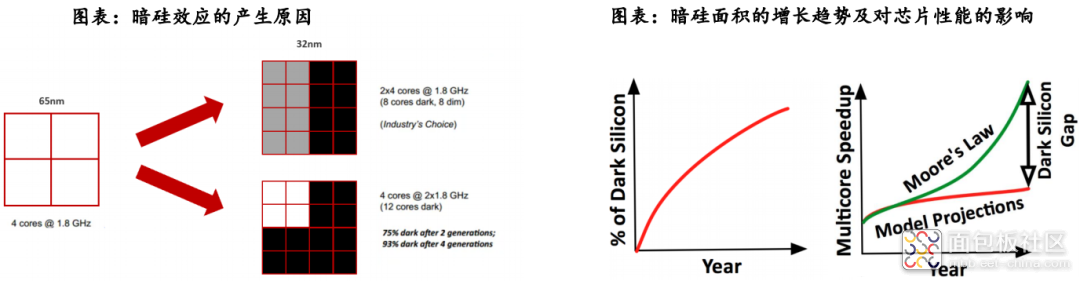

(2)FPGA是AI时代下解决暗硅效应的有效途径

暗硅效应(Dark Silicon)指由于芯片工艺和尺寸的限制,芯片上只有一小部分区域可以同时运行,其余的区域被闲置或关闭,这些闲置或关闭的区域被称为“暗硅”。在AI计算领域,由于摩尔定律的限制和散热问题,先进高效的硬件设计会更容易导致暗硅效应,限制了芯片的计算能力和应用范围。据相关论文,在22nm制程下,暗硅面积将达21%。在8nm制程下,暗硅面积将提升至50%以上。由于暗硅效应,预计到2024年平均只能实现7.9倍的加速比,与每代性能翻倍的目标相比差距将近24倍。

FPGA的可编程性和可重构性使其能够灵活地部署和优化计算任务,从而在一定程度上缓解了暗硅效应的影响。简单来说,FPGA减少暗硅效应的方法有两个方向,一是通过优化电路结构,尽可能减少不活跃区域的数量;二是通过动态重构电路,使得不活跃区域可以被重用。

4.ASIC:云计算专用高端芯片

ASIC(Application Specific Integrated Circuit)专用集成电路:是一种为专门应特定用户要求和特定电子系统的需要而设计、制造的集成电路。ASIC具有较高的能效比和算力水平,但通用性和灵活性较差。

能效方面:由于ASIC是为特定应用程序设计的,其电路可以被高度优化,以最大程度地减少功耗。根据Bob Broderson数据,FPGA的能效比集中在1-10MOPS/mW之间。ASIC的能效比处于专用硬件水平,超过100MOPS/mW,是FPGA的10倍以上。算力方面:由于ASIC芯片的设计目标非常明确,专门为特定的应用场景进行优化,因此其性能通常比通用芯片更高。根据头豹研究院数据,按照CPU、GPU、FPGA、ASIC顺序,芯片算力水平逐渐增加,其中ASIC算力水平最高,在1万-1000万Mhash/s之间。

随着技术、算法的普及,ASIC将更具备竞争优势。ASIC在研发制作方面一次性成本较高,但量产后平均成本低,具有批量生产的成本优势。目前人工智能属于大爆发时期,大量的算法不断涌出,远没有到算法平稳期,ASIC专用芯片如何做到适应各种算法是当前最大的问题。但随着技术、算法的普及,ASIC将更加具备竞争优势。

ASIC主要应用在推断场景,在终端推断市场份额最大,在云端推断市场增速较快。

5.国产CPU多点开花加速追赶

全球服务器CPU市场目前被Intel和AMD所垄断,国产CPU在性能方面与国际领先水平仍有差距。根据Counterpoint数据,在2022年全球数据中心CPU市场中,Intel以70.77%的市场份额排名第一,AMD以19.84%的份额紧随其后,剩余厂商仅占据9.39%的市场份额,整体上处于垄断局面;目前国内CPU厂商主有海光、海思、飞腾、龙芯、申威等。通过产品对比发现,目前国产服务器CPU性能已接近Intel中端产品水平,但整体上国内CPU厂商仍在工艺制程、运算速度(主频)、多任务处理(核心与线程数)方面落后于国际先进水平。

6.生态体系逐步完善,国产GPU多领域追赶

全球GPU芯片市场主要由海外厂商占据垄断地位,国产厂商加速布局。全球GPU市场被英伟达、英特尔和AMD三强垄断,英伟达凭借其自身CUDA生态在AI及高性能计算占据绝对主导地位;国内市场中,景嘉微在图形渲染GPU领域持续深耕,另外天数智芯、壁仞科技、登临科技等一批主打AI及高性能计算的GPGPU初创企业正加速涌入。

图形渲染GPU:目前国内厂商在图形渲染GPU方面与国外龙头厂商差距不断缩小。芯动科技的“风华2号”GPU采用5nm工艺制程,与Nvidia最新一代产品RTX40系列持平,实现国产图形渲染GPU破局。景嘉微在工艺制程、核心频率、浮点性能等方面虽落后于Nvidia同代产品,但差距正逐渐缩小。

在GPGPU方面,目前国内厂商与Nvidia在GPGPU上仍存在较大差距。制程方面,目前Nvidia已率先到达4nm,国内厂商多集中在7nm;算力方面,国内厂商大多不支持双精度(FP64)计算,在单精度(FP32)及定点计算(INT8)方面与国外中端产品持平,天数智芯、壁仞科技的AI芯片产品在单精度性能上超过NVIDIAA100;接口方面,壁仞科技与Nvidia率先使用PCle5.0,其余厂商多集中在PCle4.0;生态方面,国内企业多采用OpenCL进行自主生态建设,与NvidiaCUDA的成熟生态相比,差距较为明显。

7.FPGA/ASIC国产替代正当时

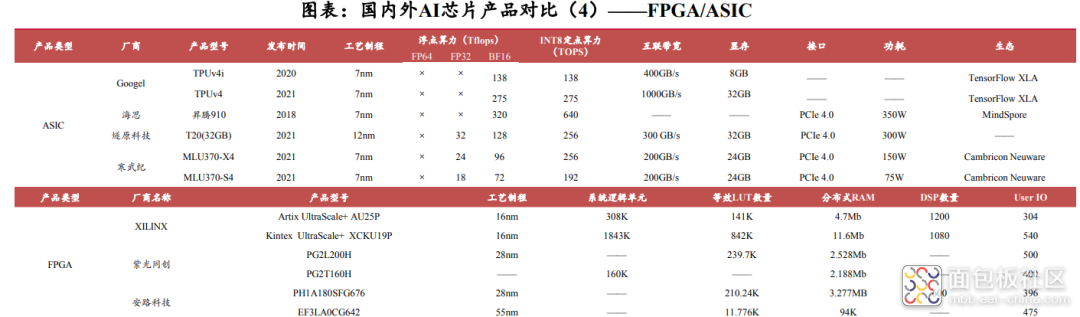

FPGA全球市场呈现“两大两小”格局,Altera与Xilinx市占率共计超80%,Lattice和Microsemi市占率共计超10%;整体来看,安路科技、紫光同创等厂商处于国际中端水平,仍需进一步突破。工艺制程方面,当前国产厂商先进制程集中在28nm,落后于国际16nm水平;在等效LUT数量上,国产厂商旗舰产品处于200K水平,仅为XILINX高端产品的25%左右。

ASIC不同于CPU、GPU、FPGA,目前全球ASIC市场并未形成明显的头部厂商,国产厂商快速发展;通过产品对比发现,目前国产厂商集中采用7nm工艺制程,与国外ASIC厂商相同;算力方面,海思的昇腾910在BF16浮点算力和INT8定点算力方面超越Googel最新一代产品TPUv4,遂原科技和寒武纪的产品在整体性能上也与Googel比肩。未来国产厂商有望在ASIC领域继续保持技术优势,突破国外厂商在AI芯片的垄断格局。

[size=1.412em]

/5

/5