Meta 上周宣布了一个新的大语言模型 LLaMA-13B,称其参数规模更小但性能强于 OpenAI 的 GPT-3 模型,且它能运行在单张显卡上。LLaMA 语言模型的规模从 70 亿到 650 亿参数,而 OpenAI GPT-3 模型有 1750 亿个参数。Meta 使用 Common Crawl、维基百科和 C4 等公开数据集训练其模型,它有可能公开其源代码和权重。今天绝大部分最先进的语言模型都没有公开源代码。Meta 称 LLaMA 为其基础模型,它将是未来该公司更先进模型的基础。它的 LLaMA-13B 模型在 BoolQ、PIQA、SIQA、HellaSwag、WinoGrande、ARC 和 OpenBookQA 等标准测试中的表现超过了 GPT-3。GPT-3 等衍生模型需要数据中心规模的计算能力进行处理,而 LLaMA-13B 能运行在单张显卡上,为在消费者硬件上实现类似 ChatGPT 的性能打开了大门。

https://research.facebook.com/publications/llama-open-and-efficient-foundation-language-models/

https://github.com/facebookresearch/llama

基于 LLaMA 的 AI 聊天机器人开源实现

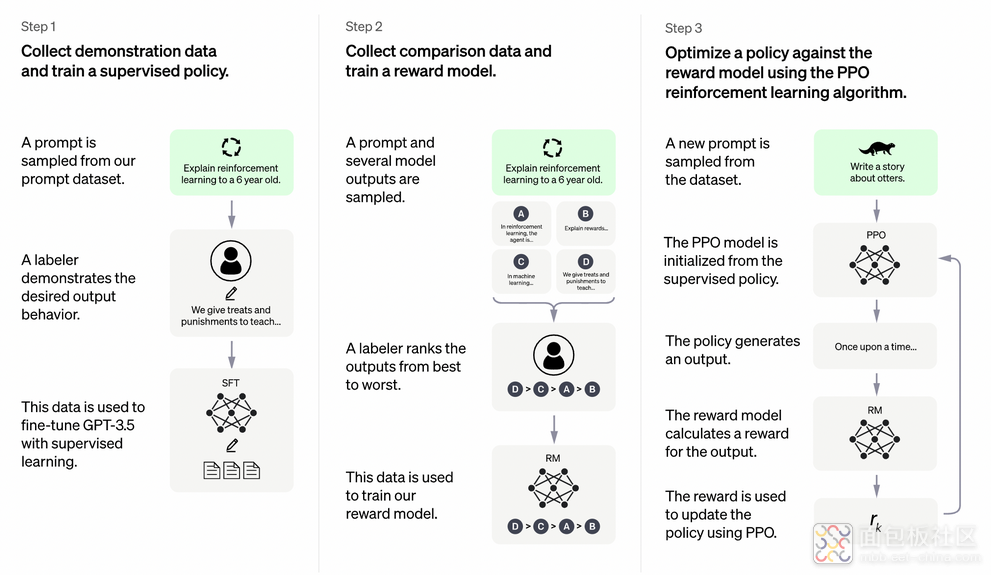

Meta 的大语言模型 LLaMA 最近引起了广泛关注,它的一大优势是参数规模更小但性能强于 OpenAI 的 GPT-3 模型,而且能运行在单张显卡上,让普通消费者的硬件也有可能提供类似 ChatGPT 性能的 AI 聊天机器人。LLaMA 是一组大语言模型的集合,其参数规模从 70 亿到 650 亿,它最新的 LLaMA-13B 模型有 130 亿个参数,不到 GPT-3 模型 1750 亿个参数的十分之一。现在 Nebuly AI 推出了首个基于人类反馈强化学习的 LLaMA AI 聊天机器人开源实现 ChatLLaMA。

https://github.com/nebuly-ai/nebullvm/tree/main/apps/accelerate/chatllama

(solidot)

/3

/3