自世界上第一台计算机诞生,经过半个多世纪,一直存在科幻小说中的量子计算机,终于走入现实了。

这个“世界首台”是货真价实的“中国造”,属中国科学技术大学潘建伟教授及其同事陆朝阳、朱晓波等,联合浙江大学王浩华教授研究组攻关突破的成果。相关系列成果发表于国际学术期刊《自然-光子学》和《物理评论快报》上。

这次一共发布了两个量子计算机的原型,一种基于超导,一种基于光学。

以下是量子信息与量子科技创新研究院相关文章对此次中科院研究突破的介绍。

世界首台超越早期经典计算机的单光子量子计算机

多粒子纠缠的操纵作为量子计算的技术制高点,一直是国际角逐的焦点。

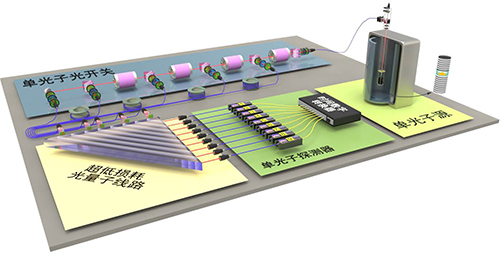

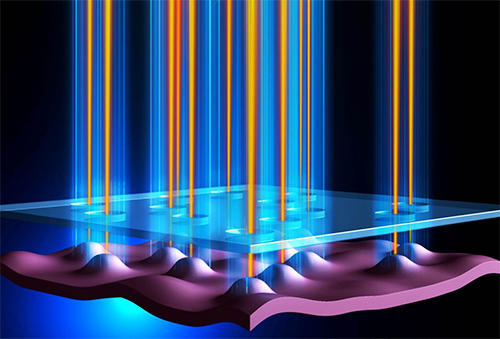

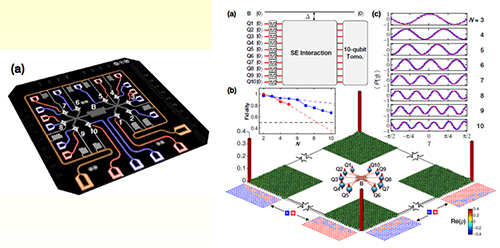

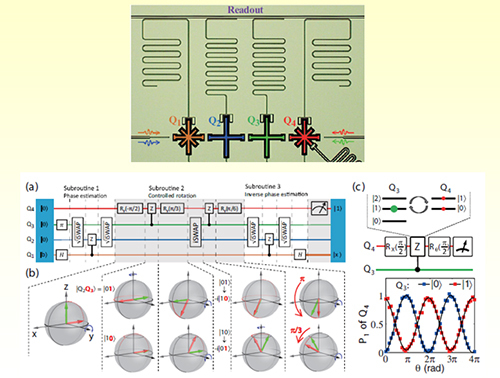

在光子体系方面,潘建伟团队在多光子纠缠领域始终保持着国际领先水平,并于2016年底把纪录刷新至十光子纠缠。在此基础上,团队利用自主发展的综合性能国际最优的量子点单光子源,通过电控可编程的光量子线路,构建了针对多光子“玻色取样”任务的光量子计算原型机。

实验测试表明,该原型机的“玻色取样”不仅比之前国际同行所有类似实验提速至少24000倍,同时,通过和经典算法比较,也比人类历史上第一台电子管计算机(ENIAC)和第一台晶体管计算机(TRADIC)运行速度快10-100倍。

潘建伟说,这是历史上第一台超越早期经典计算机的基于单光子的量子模拟机,为最终实现超越经典计算能力的量子计算这一被国际学术界称为“量子称霸”的目标,奠定了坚实的基础。朝着这一目标,潘建伟团队计划在今年年底实现大约20个光量子比特的操纵。

基于单光子的量子计算原型机结构

国际上最高品质和最高效率的单光子源

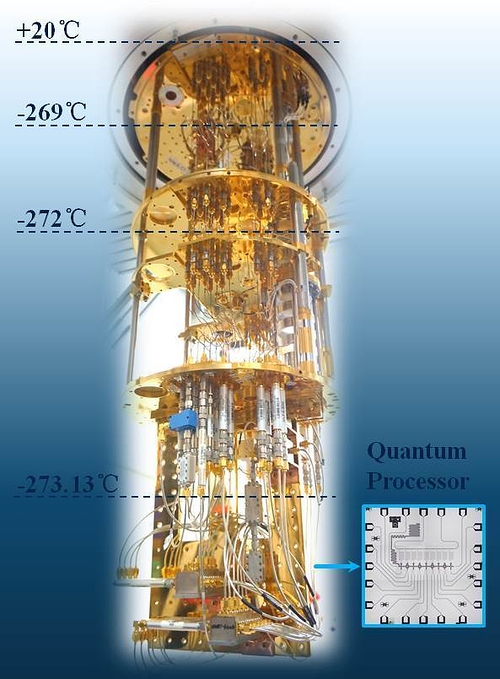

世界上纠缠数目最多(十个)的超导量子比特处理器

在超导体系方面,研究团队打破了之前由谷歌、美国国家航空航天局(NASA)和加州大学圣塔芭芭拉分校(UCSB)公开报道的九个超导量子比特的操纵,实现了目前世界上最大数目的十个超导量子比特的纠缠,并在超导量子处理器上实现了快速求解线性方程组的量子算法。

研究团队目前正致力于20个超导量子比特样品的设计、制备和测试,并计划于今年年底前发布量子云计算平台。

M001BA2CggSDlkJTEiABUXeAAD11sEUydo899.jpg593x806 59.4 KB

M001BA2CggSDlkJTEiABUXeAAD11sEUydo899.jpg593x806 59.4 KB 超导量子计算机。图据潘建伟发布会ppt

十超导量子比特的纠缠态

基于超导量子处理器的线性方程解法演示

什么是量子计算机?究竟有多快?

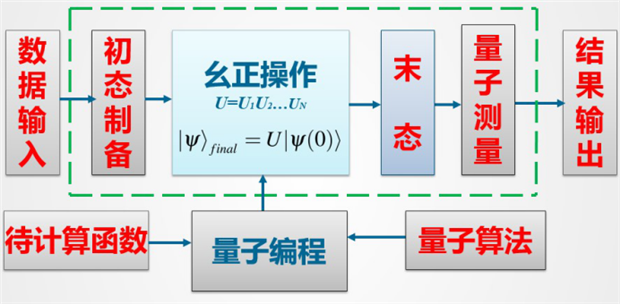

量子计算机是指利用量子相干叠加原理,理论上具有超快的并行计算和模拟能力的计算机。计算能力随可操纵的粒子数呈指数增长,可为经典计算机无法解决的大规模计算难题提供有效解决方案。

量子计算技术主要通过发展高精度、高效率的量子态制备与相互作用控制技术,实现规模化量子比特的相干操纵。由于其巨大的潜在价值,欧美各国都在积极整合各方面研究力量和资源,开展协同攻关,同时,谷歌、微软、IBM等大型高科技公司也强势介入量子计算研究。

潘建伟:波色取样,50个光子纠缠能让模拟机计算能力超越“天河二号”

2015中国计算机大会上,中科院院士、中科大常务副校长潘建伟发表报告《量子计算与量子模拟》。潘建伟长期从事量子光学等方面的研究工作,是中国空间量子科学实验卫星计划的首席科学家,其研究成果同伦琴发现X射线、爱因斯坦建立相对论等一起选为“百年物理学21篇经典论文”。

潘建伟介绍,由于高精度量子操控技术的极端复杂性,目前量子计算研究仍处在早期发展阶段,像经典计算机那样具有通用功能的量子计算机最终能否成功,对整个科学界还是个未知数。

但理论研究表明,与通用量子计算机相比较,量子模拟机这样一类针对解决一些重大问题的专用量子计算机,在量子比特数目等方面的技术要求并没有那么高。例如,对“波色取样”这样的问题,一旦达到50个左右光子的纠缠,量子模拟机的计算能力就能超过目前最快的“天河二号”超级计算机。潘建伟说,量子模拟具有重大实用价值,可为人类开发新材料和新能源提供重要指导,孕育和推动物质科学领域新一代技术革命和产业变革,有望在10至15年内取得重大突破。

2017 转折之年:量子计算机将从实验室走进现实

2017年1月,《Nature》曾发表文章,称2017年是量子计算的转折之年,更多技术将从实验室走向现实。

《Nature》的文章盘点了量子计算上的进展:谷歌在2014年开始研究基于超导超导的量子计算机,他们希望在今年,或者稍晚一些的时候,能够超越最强大的“传统”计算机所能做到的计算能力,这一里程碑式的成就被命名为量子霸业。谷歌的竞争对手——微软,把赌注压在了一个非常吸引人但是还未经验证的概念——拓扑量子计算上,并希望成为首个展示这一技术的公司。

超导量子计算机路线图

中国科学家们日前发表的这一研究,在基于光子和超导体系的量子计算机研究方面取得了两项重大突破性进展,为在传统计算机上实现“量子计算霸权”奠定了坚实的基础,也为2017年这一转折之年描下了浓墨重彩的一笔。

科普:量子计算的意义

以半导体芯片为核心的计算机的发明成就了现代信息技术产业(硬件、软件、网络、通信等)的高速发展,深刻改变了人类的社会活动形式,甚至是国防安全和国家核心竞争力。半导体集成电路芯片几十年以来一直沿着“摩尔定律”发展,单位芯片上晶体管数目越来越多,集成度越来越高。

截止到目前,集成电路芯片制造工艺处于14&10nm技术代量产阶段,更小尺寸的技术代(7nm和5nm)处于研发阶段。在可预见的未来将达到控制电子的物理极限,当单个晶体管缩小到只能容纳一个或几个电子时,就会出现单电子晶体管(量子点),量子隧穿效应将不可避免的影响电子元器件的正常工作。尽管科研人员正在努力通过各种手段进一步延续晶体管的制程尺寸并同时开发多核芯片技术,但相关技术只能在有限范围内优化传统芯片性能,无法阻止“摩尔定律”必将被打破的历史趋势。

当现代计算机芯片在经典物理领域内无法进一步提升结构性能时,可以研究探索有别于当前计算机架构的新型结构和多核芯片,或者研究量子力学规律开发量子计算。新型结构需要抛弃当前计算机所遵循的冯·诺依曼架构,而量子计算则需要改变现有半导体芯片的基本结构,利用量子叠加和量子纠缠来实现逻辑运算。国际半导体技术发展路线图认为多核芯片等技术只能短期延续摩尔定律,中长期必然要发展以量子物理为基础的量子计算等颠覆性、革命性新型器件来超越摩尔定律,信息的量子化趋势将不可避免。量子计算是芯片尺寸突破经典物理极限的必然产物,是后摩尔时代具有标志性的技术。

量子计算机工作原理

对于现代计算机而言,通过控制晶体管电压的高低电平,从而决定一个数据到底是“1”还是“0”,采用“1”或“0”的二进制数据模式,俗称经典比特,其在工作时将所有数据排列为一个比特序列,对其进行串行处理。

而量子计算机使用的是量子比特,量子计算机能秒杀传统计算机得益于两个独特的量子效应:量子叠加和量子纠缠。量子叠加能够让一个量子比特同时具备0和1的两种状态,量子纠缠能让一个量子比特与空间上独立的其他量子比特共享自身状态,创造出一种超级叠加,实现量子并行计算,其计算能力可随着量子比特位数的增加呈指数增长。

理论上,拥有50个量子比特的量子计算机性能就能超过目前世界上最先进的超级计算机“天河二号”,拥有300个量子比特的量子计算机就能支持比宇宙中原子数量更多的并行计算,量子计算机能够将某些经典计算机需要数万年来处理的复杂问题的运行时间缩短至几秒钟。

此外,量子计算的信息处理过程是幺正变换,幺正变换的可逆性使得量子信息处理过程中的能耗较低,能够从原理上解决现代信息处理的另一个关键技术--高能耗的问题。因此,量子计算技术是后摩尔时代的必然产物。

量子计算技术不仅能克服现代半导体工艺因为尺寸减小而引起的热耗效应,还能利用量子效应实现功能强大的并行计算,极大地提高计算速度和信息处理能力。规模化通用量子计算机的诞生将极大地满足现代信息的需求,在海量信息处理、重大科学问题研究等方面产生巨大影响,甚至对国家的国际地位、经济发展、科技进步、国防军事和信息安全等领域发挥关键性作用。

这一特性让量子计算机拥有超强的计算能力,为密码分析、气象预报、石油勘探、药物设计等所需的大规模计算难题提供了解决方案,并可揭示高温超导、量子霍尔效应等复杂物理机制,为先进材料制造和新能源开发等奠定科学基础。

(量子信息与量子科技创新研究院,新智元,科普中国)

/3

/3