在高性能计算领域,Chiplet 是满足当下对算力需求的关键技术。运用 Chiplet 技术,一方 面通过 Die to Die 连接和 Fabric 互联网络,能够将更多算力单元高密度、高效率、低功耗 地连接在一起,从而实现超大规模计算;另一方面,通过将 CPU、GPU 和 NPU 高速连接在同一 个 Chiplet 中,实现芯片级异构系统,可以极大提高异构核之间的传输速率,降低数据访问 功耗,从而实现高速预处理和数据调度;同时,其采用非先进制程构建 Cache(位于 CPU 与 内存之间的临时存储器),提高片上 Cache 的容量和性价比,并通过 3D 近存技术,降低存储访问功耗,从而满足大模型参数需求。

从下游应用场景来看,服务器、自动驾驶领域是比较适合 Chiplet 落地场景,消费电子由于 对轻薄、功耗要求较高,不太适合应用 Chiplet。随着近年来高性能计算、人工智能、5G、 汽车、云端等新兴市场的蓬勃发展,对于算力的需求持续攀升,仅靠单一类型的架构和处理 器无法处理更复杂的海量数据,“异构”正在成为解决算力瓶颈关键技术方向。Chiplet 技术 目前主要聚焦于 HPC 高性能计算与 AI 人工智能领域,随着算力、存储等需求升级,Chiplet 有望在未来市场上得到更加广泛的应用。 国际巨头厂商已经布局 Chiplet 在高性能计算领域的应用。英特尔于 2022 年底发布了数据 中心 GPU Max,是英特尔针对高性能计算加速设计的第一款 3D GPGPU,在一颗芯片里集成了 47 颗芯粒,有 5 种制程,以此获得比上一代高出三倍性能的提升。

AMD 在这个方向走在了更前面,目前已经发布了第一个数据中心 APU(Accelerated Processing Unit,加速处理器)产品 MI300,其采用 Chiplet 技术,在 4 块 6 纳米芯片上, 堆叠了 9 块 5 纳米的计算芯片。AMD 表示,相较于上一代的 Instinct MI250,提升了 8 倍的 AI 训练算力和 5 倍的 AI 能效。 苹果则与台积电合作开发了 UltraFusion 封装技术,也是一种类似 Chiplet 的技术,能同时 传输超过 1 万个信号,芯片间的互连带宽可达 2.5TB/s,超出了 UCIe 1.0 的标准。苹果此前发布的 M1 Ultra 芯片将两个 M1 Max 芯片的裸片,采用 UltraFusion 封装技术进行互连,其 CPU 核心数量增加至 20 个,而 GPU 核心数量更是直接增加至 64 个。M1 Ultra 的神经网络引 擎也增加至 32 核,能够带来每秒 22 万亿次的运算能力。

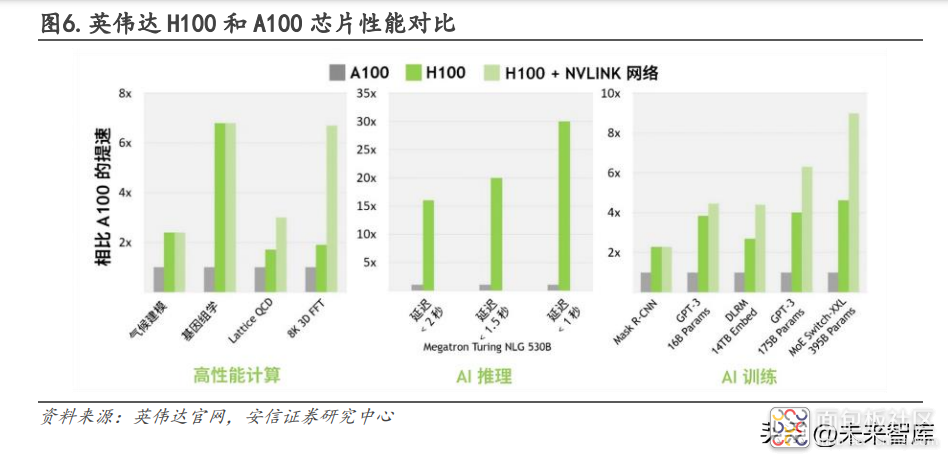

以 ChatGPT 为代表的的 AI 应用蓬勃发展,对上游 AI 芯片算力提出了更高的要求,而运用 Chiplet 模式的异构集成方案,可以通过将通用需求与专用需求解耦,大幅降低芯片设计投 入门槛及风险,有效解决下游客户在算法适配、迭代周期、算力利用率、算力成本等各方面 难以平衡的核心痛点。将支持人工智能的不同功能的芯片,如 GPU、CPU、加速器等,通过 Chiplet 的方式进行组合,可以构建出更高效的 AI 加速器系统。国际巨头厂商与国内领先厂 商均在 Chiplet 技术于 AI 芯片的运用做了不同突破。 英伟达使运用 Chiplet 技术制作 AI 芯片的领先企业,其于 2022 年发布的 H100 GPU 芯片就 是台积电 4nm 工艺和 Chiplet 技术融合的创新之作。英伟达通过 Chiplet 技术将 HBM3 显存 子系统集成到芯片里,可提供 3TB/s 的超高显存带宽,是上一代产品带宽的近两倍。同时借 助 4nm 先进制程,H100 GPU 芯片在 814 平方毫米的芯片面积里容纳 800 亿个晶体管,无论是 性能还是延迟,相较于上一代 A100 GPU 芯片都有巨大的提升。

英伟达另一款 AI 芯片 GH200 与 H100 属于同一际代,但应用场景有所不同。英伟达 H100 的 架构以 GPU 为主,重点用于数据运算和推理。GH200 架构采用 CPU+GPU 异构计算方式。GH200 采用 NVLink-C2C 技术方案,通过 Chiplet 工艺将基于 Arm 的 NVIDIA Grace CPU 与 NVIDIA H100 Tensor Core GPU 整合在了一起,实现流畅互连。具体来说,GH200 超级芯片将 72 核 的 Grace CPU、H100 GPU、96GB 的 HBM3 和 512 GB 的 LPDDR5X 集成在同一个封装中,拥有高 达 2000 亿个晶体管。这种组合提供了 CPU 和 GPU 之间高达 900G/s 的数据带宽,为某些内存 受限的工作负载提供了巨大的优势。相较 PCIe5,NVLink-C2C 在能效方面提升 25 倍,面积效 率提升 90 倍。

AMD 的 MI300 加速器也运用了 Chiplet 技术,是业内首款 CPU+GPU 异构计算的存算一体芯片。 MI300 加速器专为领先的高性能计算(HPC)和 AI 性能而设计,这款加速卡采用 Chiplet 设 计,拥有 13 个小芯片,基于 3D 堆叠,包括 24 个 Zen4 CPU 内核,总共包含 128GB HBM3 显存和 1460 亿晶体管,性能上比此前的 MI250 提高了 8 倍,在功耗效率上提高了 5 倍。

中国首款基于 Chiplet 的 AI 芯片“启明 930”为北极雄芯开发,该芯片采用 12nm 工艺生产, 中央控制芯粒采用 RISC-V CPU 核心,可通过高速接口搭载多个功能型芯粒,并基于全国产 基板材料以及 2.5D 封装,做到算力可拓展,提供 8~20TOPS(INT8)稠密算力来适应不同场 景,目前已与多家 AI 下游场景合作伙伴进行测试。

(报告出品方/作者:安信证券,马良、郭旺)

/2

/2